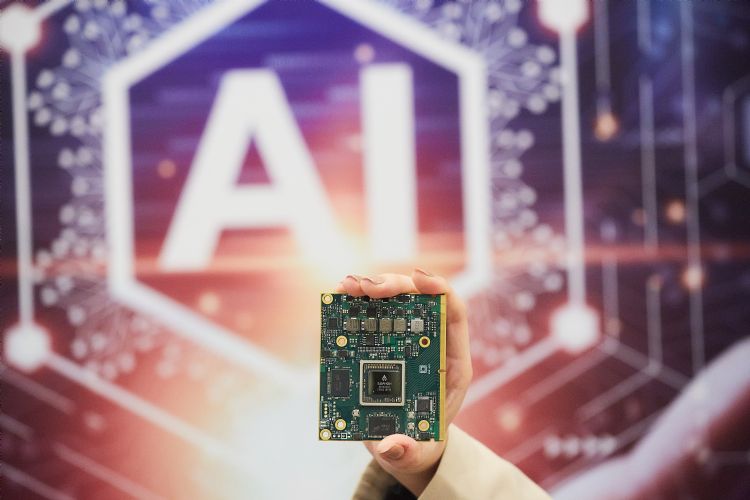

美国对中国实施芯片制裁措施,正促使中国科技从业者加速研发不依赖最新美国芯片的先进人工智能(AI)技术。

华尔街日报检验研究论文并采访员工后发现,中国从业者正在研究利用更少、性能没那么强大的半导体,就能达成最先进AI性能的技术,同时也研究如何组合不同类型的芯片,避免只仰赖单一类型芯片。

包括华为、百度与阿里巴巴,都是想办法从现有的电脑芯片中发掘更多用处的行业。

研究人员和分析师表示,利用这些变通的方法来追上美国AI领导者,实际上仍是一大挑战,但一些实验显示,如果取得成功,这些研究可让中国科技行业同时挺过美国的制裁措施,并且在面对未来的限制措施时,自身将更具韧性。

华为和百度不愿回应置评,阿里巴巴则没有理会置评。

随着要将ChatGPT这类模型商业化的竞赛升温,全球企业需要更多性能强大的芯片,同时还要想办法竭力善用这些芯片,以便压低这些飙高中的AI研发成本。

对中企来说,这是个极关键的问题,因为美国的制裁措施无法使企业获得像是英伟达(Nvidia)制的最先进芯片,此外,员工、AI研究人员和产业分析师表示,中企已迅速消耗掉现有的美国芯片来打造与ChatGPT相类似的软件。

脸书母公司Meta Platforms的AI基础架构与大型语言模型研究人员张苏珊(Susan Zhang,音译)表示:「目前可以从字里行间看出他们试图寻找世界上任何一种运算方式来弥补先进硬件的不足。」

北京最高决策机构上月表示,中国应鼓励AI研发创新;美国拜登政府在去年10月全面限制向中国供应芯片后,已明示未来可能进一步实施限制措施。

中企现在无法获得目前最受业界欢迎的AI开发芯片A100,以及3月推出的新一代版本、能提供更多算力的H100芯片。

不过,英伟达为中国市场创造出降级版的芯片,分别是A800与H800,两款修改后的芯片降低芯片与芯片之间的沟通能力。这些产品可为开发小型AI模型提供有效的替代方法,这类小型AI模型就像是驱动短视频App抖音(TikTok)的推荐算法所使用的模型。不过,这类芯片无法用于发展大型AI模型,因为大型AI模型需要数百或数千个芯片共同协力运作,举例来说,瑞银分析师估计训练像ChatGPT的AI模型,需要5000至10000个A100芯片来进行训练。

与政府有关的半导体产业协会的调查显示,在中国境内可用于训练大型AI模型的A100芯片大约有4万个至5万个,显示供应吃紧。知情人士说,在美国制裁前就已囤积A100芯片的阿里巴巴与百度等行业都已严格限制内部使用外国的先进芯片,把这些芯片保留用于需要强力运算的任务。

根据开源研究论文和知情人士透露,百度近年来一直寻求将海光信息的DCU、华为的AI训练芯片Ascend以及自家的昆仑芯片等国产芯片整合到AI研发中。一些知情人士说,许多国产芯片在训练大规模模型时仍然不可靠,因为容易瘫痪。

另据经营AI基础设施公司HPC-AI Tech的新加坡大学教授尤洋的说法,许多中企正试图把三或四种不怎么先进的芯片组合在一起,来模拟英伟达最先进处理器的性能。

例如在4月,腾讯就公布了一套新的运算群,即使用英伟达H800芯片进行大型AI模型训练的一组连结芯片。

尤洋说,这种做法可能非常消耗成本,例如一家美企若需要1000个H100芯片来训练大型语言模型,那么一家中企便需要3000个以上的H800芯片来达成同样成果。

虽然在全球研究圈中仍不太使用这类方法,而且难以实行,但中国研究人员目前已经取得了一些进展。例如华为研究人员在3月的一篇论文中展示如何只利用该公司的Ascend芯片、而不使用英伟达的芯片,来训练华为最新一代大型语言模型。尽管存在缺点,但这个名为PanGu-Σ的模型已达到一些汉语任务的先进性能表现,包括阅读理解和文法问题。